콘텐츠

상위

에지 컴퓨팅

에지 컴퓨팅 관련 주요 기사

에지 AI 및 머신 러닝

머신 러닝 학습 방법

임베디드 머신 러닝

에지 AI 관련 주요 기사

ML 소프트웨어(TensorFlow 및 LiteRT 포함)

TensorFlow

LiteRT

PyTorch 및 ExecuTorch

ML 소프트웨어 관련 주요 기사

에지 AI 및 ML 하드웨어

요구 사항

NPU

TPU

입문 수준 제품

중간 수준 제품

고급 수준 제품

전문가 수준 제품

추가 제품

에지 AI 하드웨어 관련 주요 기사

Edge Impulse

Edge Impulse 관련 주요 기사

인기 있는 Edge Impulse 제품

AI를 통한 감지

머신 러닝이 탑재된 비전 센서

인기 있는 AI 비전 센서 제품

AI 비전 센서 관련 주요 기사

머신 러닝이 탑재된 동작 센서

인기 있는 AI 동작 센서 제품

동작 센서 관련 주요 기사

머신 러닝이 탑재된 환경 센서

인기 있는 환경 AI 센서 제품

에지 AI

에지 컴퓨팅이란, 말 그대로 네트워크 에지에 있는 데이터 소스의 물리적 위치 또는 근처에서 이루어지는 컴퓨팅을 의미하며, 멀리 떨어진 데이터 센터에서 처리되는 클라우드 컴퓨팅과는 다릅니다. 스마트 홈 어시스턴트(Alexa 또는 Siri) 등의 제품에 에지 AI가 탑재되어 있습니다. "헤이 알렉사"라고 말하면 에지 AI가 그 문구를 인식하여 스마트 홈 어시스턴트를 깨웁니다.

에지 AI와 머신 러닝은 시스템 및 장치가 원격 서버에 의존하지 않고 데이터가 생성되는 곳에서 실시간으로 의사 결정을 내릴 수 있도록 데이터 처리 방식을 변화시켜 왔습니다. 기술이 급속히 발전함에 따라 엔지니어들은, 다양한 산업 분야에서 실시간으로 의사 결정을 하는 지능형 자율 시스템 개발을 위해 이러한 개념을 이해하고 적용하는 것이 점점 더 중요해지고 있습니다. 이 매거진에서는 에지 AI와 머신 러닝이 사용되는 하드웨어, 소프트웨어 및 일부 응용 분야와 이를 통해 해결할 수 있는 문제에 대해 다룹니다.

에지 컴퓨팅

컴퓨팅 서비스에 대한 수요가 날로 증가함에 따라, 대규모의 중앙 집중식 데이터 센터로부터 벗어나려는 움직임은 의외로 느껴질 수 있습니다. 하지만 데이터 소스와 더 가까운 곳에서 컴퓨팅을 하면 개인정보 보호에 대한 걱정을 줄일 수 있습니다. 이전에는 주변 장치와 단말의 영역이었던 네트워크 에지에서 이제는 고급 처리 기능이 구현되고 있습니다.

실시간 처리가 늘어나면서 에지 컴퓨팅의 필요성이 더욱 증가하고 있습니다. 에지 컴퓨팅은 이미 여러분의 주위에서 사용되고 있을 수도 있습니다.

- 스마트 홈 어시스턴트(Alexa, Google, Siri 등)는 에지 컴퓨팅의 한 형태인 '호출 명령어' 감지를 사용합니다. 이러한 경우, 장치는 빠르게 응답하고 사용자의 개인 정보를 보호해야 하므로 에지 컴퓨팅이 필요합니다.

- 운전자가 차선을 벗어날 때 알림을 제공하는 등의 기능에 중점을 둔 첨단 운전자 지원 시스템(ADAS)에서는 클라우드에 갔다 와야 하는 처리 시간을 기다리거나 네트워크의 응답 지연 위험을 감수할 수 없습니다.

- 환자 모니터링(예: 혈당 모니터)은 환자 근처에서 사용됩니다. 데이터는 해당 환자의 스마트폰(또는 로컬 장치)으로만 전송할 수 있으며, 이를 통해 건강 데이터를 보호하여 인터넷에 노출될 가능성을 줄일 수 있습니다.

- 예지보전 모델은 산업용 모터의 진동 변화에 대한 이상을 감지하여 모터가 고장나는 시점을 예측합니다. 이상 징후가 감지되면 경고가 발생하고 이후 클라우드로 전송하겠지만, 그 외의 시간에 소프트웨어는 에지에서 데이터를 분석하고 있으므로 네트워크 혼잡을 줄일 수 있습니다.

에지 컴퓨팅과 클라우드 컴퓨팅의 차이점은 무엇인가요? 답변 보기

클라우드 컴퓨팅은 보통 데이터 센터(일반적으로 생성되는 데이터가 처리되는 곳에서 멀리 떨어져 있음) 내에 상주하는 일련의 서비스를 의미합니다. 클라우드 컴퓨팅 워크로드는 중앙 처리 장치(CPU) 또는 그래픽 처리 장치(GPU)가 구동되는 서버에서 처리됩니다.

에지 컴퓨팅은 생성되는 데이터와 가까운 곳에 위치한 서비스를 의미합니다. 에지 컴퓨팅 워크로드는 보통 마이크로 컨트롤러 또는 단일 기판 컴퓨터(SBC)에서 처리됩니다.

에지 컴퓨팅 관련 주요 기사

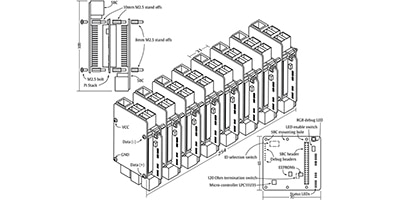

단일 기판 컴퓨터를 사용하여 IIoT 에지 컴퓨팅 플랫폼 생성

단일 기판 컴퓨터(SBC)는 에지에서 탁월한 처리 성능을 제공할 수 있지만, 설계자는 가장 적합한 솔루션을 선택하여 적용하는 방법을 알아야 합니다.

Efinix의 Quantum 지원 FPGA를 사용하여 저전력 고성능 에지 컴퓨팅 구현

Efinix의 Quantum 지원 FPGA를 사용하여 AI, ML 및 이미지 처리 에지 컴퓨팅 구현에서 전력, 성능, 면적 이득을 실현하세요.

AI를 통한 예측 유지 보수를 위해 전류 센서를 사용하여 효과적으로 데이터 수집

설계자는 복잡한 다축 가속도계 대신 간단한 센서를 선택하여 인공 지능을 위한 데이터 수집을 간소화할 수 있습니다.

Install Home Assistant and Set Up a Cost-Effective Smart Home Hub

Let’s take a look at the installation and setup process of Home Assistant on a cost and power-effective x86 single-board computer (SBC)

에지 AI 및 머신 러닝

인공지능(AI)과 머신 러닝(ML)의 가장 포괄적인 의미는 컴퓨터 알고리즘과 통계 모델을 사용하여 직접적인 명시적 지시 없이 작업 성능을 향상시키는 것입니다. 이 기능을 통해 개발자가 모든 동작을 정의하지 않아도 명시적으로 정의된 기존 프로그래밍에 변화를 가져와, 인터넷 콘텐츠 추천, 음성 인식, 의료 및 자율 주행 자동차에 이르기까지 거의 모든 분야에서 새로운 용도로 활용되고 있습니다.

일상 생활에서 점점 더 많은 시스템이 어느 정도 수준의 ML 상호작용을 사용하게 되면서, 엔지니어와 개발자가 사용자 상호작용의 미래를 이해하기 위해서는 이러한 세계를 이해하는 것이 매우 중요해졌습니다.

인공지능(AI)은 광범위한 분야이며, 특히 머신 러닝(ML)은 에지에서 가장 많은 기회가 있을 것으로 예상되는 분야입니다. 머신 러닝은 통계 알고리즘을 기반으로 패턴 매칭을 수행하는 프로세스입니다.

신경망 사용은 머신 러닝의 일반적인 학습 방법 중 하나이며, 아래 그림은 이러한 모델의 노드와 가중치를 나타냅니다.

딥러닝이란 신경망에 여러 개의 숨겨진 레이어가 있는 특수한 유형의 머신 러닝입니다.

머신 러닝 모델이란 무엇인가요? 답변 보기

머신 러닝 모델이란 학습 데이터에서 발견된 패턴을 기반으로 입력 데이터를 인식하고 분류하도록 설정된 소프트웨어 프로그램입니다. ML 모델은 학습 데이터를 사용하여 데이터에서 발견되는 패턴을 추출한 다음, 이러한 패턴을 사용하여 향후 결과를 예측하고 더 정확한 모델로 다듬을 수 있습니다.

머신 러닝 학습 방법

제대로 잘 작동되는 ML 모델이 탄생하려면 학습의 과정이 필요합니다. 모델을 학습시키는 데 사용할 수 있는 여러 가지 학습 방법이 있습니다.

- 지도 - 레이블과 태그가 지정된 샘플 데이터를 기반으로 하는 학습 유형으로, 마치 가정 교사가 숙제를 교정해 주는 것처럼, 출력은 알고 있는 값이어서 올바른지 여부를 확인할 수 있습니다. 이 유형의 훈련은 통상적으로 분류 작업이나 데이터 회귀와 같은 응용 분야에서 사용됩니다. 지도 학습은 매우 유용하고 정확도가 높지만, 태그가 지정된 데이터 세트에 따라 그 학습이 상당히 좌우되며 새로운 입력은 처리하지 못할 수도 있습니다.

- 비지도 - 출력이 정해진 레이블된 학습 데이터 대신 학습 알고리즘을 사용하여, 레이블이 없는 데이터 세트에서 데이터 클러스터를 연구, 분석 및 발견합니다. 통상적으로 비지도 학습은 대규모 데이터 세트를 연구하고 데이터 포인트 간의 관계를 찾아야 하는 응용 프로그램에서 사용됩니다.

- 준지도 - 지도와 비지도 학습이 혼합된 형태입니다. 학습 데이터 세트에는 태그가 지정된 데이터와 태그가 지정되지 않은 데이터가 모두 포함되어 있습니다. 준지도 학습은 다른 방법보다 더 넓은 범위의 입력 데이터를 처리할 수 있지만, 지도 학습이나 비지도 학습보다 더 복잡할 수 있으며 레이블이 지정되지 않은 데이터의 품질이 최종 모델의 정확도에 영향을 미칠 수 있습니다.

- 인간의 피드백을 통한 강화 학습(RLHF) - 명확하게 정의할 수 있는 행동, 성과 지표, 그리고 채점 및 개선이 가능한 결과를 함께 사용할 필요가 있는 학습 유형입니다. 규칙 집합과 취할 수 있는 행동을 정의함으로써, 강화 학습은 목표 조건을 달성하기 위한 다양한 행동 방침을 평가하기 위해 지속적으로 반복할 수 있습니다.

임베디드 머신 러닝

임베디드 ML은 다음과 같은 모델의 실행에 중점을 둔 머신 러닝의 하위 분야입니다.

- 낮은 지연 시간(서버를 기다리거나 서버 도달에 걸리는 네트워크 지연 시간을 해결하지 않아도 됨)

- 낮은 대역폭(네트워크를 통해 고해상도 데이터를 반환하지 않음)

- 저전력(W가 아닌 mW)

임베디드 ML 모델은 서버나 개인용 컴퓨터와 같은 대규모 데이터 처리 하드웨어에 의존하는 대신 마이크로 컨트롤러, FPGA, DSP와 같은 소형 저전력 소자에 배포될 수 있습니다.

임베디드 ML 응용 프로그램에 대한 모델 학습은 서버 또는 컴퓨터에서 수행할 수 있습니다. 이는 모든 데이터를 입력하여 결과 모델을 생성하는 과정입니다.

임베디드 ML 모델이 생성되고 나면, 임베디드 시스템에서 실행시킬 수 있습니다. 임베디드 ML의 일반적인 응용 프로그램에는 호출 명령어를 인식하고 활성화, 사람인지 사물인지 식별, 또는 센서의 데이터 스트림에 기반하여 이상 징후 탐지 등이 있습니다.

에지 AI(또는 임베디드 ML)의 이점은 무엇인가요? 답변 보기

- 낮은 지연 시간: 멀리 떨어진 서버나 네트워크 지연 시간을 기다릴 필요가 없습니다.

- 낮은 데이터 대역폭: 네트워크를 통해 대용량의 고해상도 데이터를 전송하거나 반환하지 않습니다.

- 개인정보 보호: 사전 필터링된 센서 출력에 따라 에지 장치에서 의사 결정을 내리므로 인터넷을 통해 데이터를 전파할 필요가 없습니다.

- 낮은 전력 소비: 임베디드 ML은 와트가 아닌 밀리와트 단위로 전력을 사용하므로, 배터리로 구동되는 모바일 장치에 적합합니다.

- 작은 데이터 풋프린트: 임베디드 ML은 수십 킬로바이트의 소량 플래시 메모리에 적합하도록 설계되었습니다.

- 경제적이고 저렴한 장치: 임베디드 ML은 32비트 MCU에서 로컬 연산이 가능하며, 전체 시스템 가격이 50달러 미만인 경우가 많습니다.

에지 AI 관련 주요 기사

Renesas RA8M1 MCU를 사용하여 강력하고 효율적인 AI 및 머신 러닝을 빠르게 배포

Renesas RA8M1 마이크로 컨트롤러의 Arm Helium MVE SIMD 확장을 통해 강력한 AI 및 ML을 빠르고 효율적으로 제공할 수 있습니다.

What is Edge AI? Machine Learning + IoT

The term “Edge AI” might be the new buzzword, much like “Internet of Things” was in 2016/2017. To understand this growing new trend, we need to provide a solid definition of what constitutes “Artificial Intelligence on the Edge.”

에지 지원 기계 학습 애플리케이션을 신속하게 배포하는 방법

에지에서의 기계 학습 구현이 NXP의 i.MX RT1170 크로스오버 MCU 및 관련 기판 및 소프트웨어 도구를 통해 크게 간소화되었습니다.

머신 러닝을 통해 혁신적인 홈 씬 실현: 지능형 홈 자동화를 위한 청사진

머신 러닝을 통해 스마트 홈 장치와 더욱 원활하게 상호작용할 수 있는 스마트 홈 씬을 실현할 수 있습니다.

ML 소프트웨어(TensorFlow 및 LiteRT 포함)

TensorFlow

TensorFlow는 머신 러닝 모델을 구축, 학습 및 배포하기 위한 무료 오픈 소스 소프트웨어 라이브러리입니다. 2011년 Google에서 Google Brain 프로젝트를 위해 처음 개발했으며, 2015년에 일반에 공개되었고 2019년에 업데이트된 최신 버전인 TensorFlow 2.0이 출시되었습니다.

TensorFlow는 머신 러닝 학습과 심층 신경망 추론에 있어 가장 인기 있고 널리 사용되는 프레임워크입니다. 많은 개발자가 Python API 라이브러리를 통해 TensorFlow와 상호 작용하지만, TensorFlow는 Java, JavaScript 및 C++ 프로그래밍 언어와도 호환됩니다. 타사 패키지를 사용하면 옵션이 더 늘어나서 MATLAB, R, Haskell, Rust 등의 거의 모든 언어를 사용할 수 있습니다.

LiteRT

LiteRT(이전의 TensorFlow Lite)는 소형 장치에서 구동하기 위해 설계된 TensorFlow의 하위 라인으로, 임베디드 시스템, 모바일 장치, 에지 컴퓨팅 장치와 같이 하드웨어가 제한되고 전력이 한정된 장치가 여기에 포함됩니다. 개발자는 TensorFlow에서 기존 ML 모델을 학습, 생성 또는 수정한 다음, LiteRT를 사용하여 더 작고 효율적인 소프트웨어 패키지로 변환하면 모바일 장치에서 실행할 수 있습니다.

그러나 ML 모델에 대한 추가 학습을 에지에서 수행하기에는 너무 많은 연산 능력과 시간이 필요하기 때문에, 마이크로 컨트롤러 플랫폼에 배포된 후에는 통상적으로 장치에서 추가 학습을 하지는 않습니다. 즉, 이 모델은 일반적으로 새로운 데이터 소스 없이도 오프라인 상태에서 완전히 학습되어 있습니다. 이러한 제한적인 접근 방식으로 인해, 단일 작업을 수행하는 응용 프로그램에 적합합니다. 하지만 광범위한 데이터를 분류해야 합니다.

TensorFlow와 LiteRT의 차이점은 무엇인가요? 답변 보기

TensorFlow는 전체 범용 운영 체제(GPOS)와 함께 더 큰 연산 하드웨어를 필요로 합니다.

LiteRT는 임베디드 시스템, 모바일 장치 및 에지 컴퓨팅 장치에서 ML 모델을 실행하는 데 최적화되어 있습니다.

GPOS를 돌리는 Raspberry Pi 4와 같은 단일 기판 컴퓨터(SBC)는 적절한 크기의 SBC에서 전체 TensorFlow를 실행할 수 있지만, 일반적으로 전력 소비가 10w ~ 20W로 MCU나 DSP보다 훨씬 높다는 점을 유념해야 합니다.

일반적으로 모델의 학습은 TensorFlow에서 수행되며, 가벼운 임베디드 시스템에서 실행할 모델은 LiteRT에서 실행할 수 있게 변환됩니다.

PyTorch 및 ExecuTorch

에지의 하드웨어 플랫폼에서 ML 모델을 실행할 필요성이 증가함에 따라, PyTorch는 스마트폰, 웨어러블 장치 및 임베디드 플랫폼에서 머신 러닝 모델을 실행할 수 있는 완전한 엔드 투 엔드 소프트웨어 툴인 ExecuTorch를 개발하였습니다. 모델링부터 변환 및 배포까지 일반 PyTorch와 동일한 툴체인 및 SDK를 사용할 수 있는 ExecuTorch는 다양한 CPU, NPU 및 DSP 플랫폼과도 호환됩니다.

ExecuTorch는 PyTorch 2.0으로 제작되어 사용자 친화적이며, 스마트폰 애플리케이션에 대한 안드로이드 지원을 포함하여 다양한 장치에서 지원됩니다.

PyTorch Edge, ExecuTorch, PyTorch Mobile의 차이점은 무엇인가요? 답변 보기

PyTorch Edge는 에지에서 ML 모델을 실행하는 개념입니다. PyTorch Mobile은 이를 구현한 레거시 툴셋이며, ExecuTorch는 에지에서 PyTorch 모델을 실행하기 위한 최신 툴셋입니다.

PyTorch Mobile은 PyTorch를 모바일 장치, 특히 iOS, Android 및 Linux 기반의 모바일 장치로 옮기려는 초기 시도였으나, 애플리케이션 시작 시 정적 메모리 공간을 요구하는 제약이 있었습니다. 반면 ExecuTorch는 필요할 때에만 메모리를 할당하는 동적 메모리를 사용하며, 이는 메모리가 제한된 환경에서는 매우 중요한 조치입니다.

PyTorch 프레임워크에서 TensorFlow 모델을 (또는 그 반대를) 실행할 수 있나요? 답변 보기

TensorFlow와 PyTorch는 유사한 소프트웨어 환경이긴 하지만, 현재로서는 서로 직접적으로 상호 호환되지는 않습니다. 각 시스템에서 사용하는 학습 방법과 모델 파일 출력이 다르므로, 한 생태계의 모델을 다른 생태계에 사용하는 것은 어렵습니다.

다행히도 이 두 시스템 간의 변환을 쉽게 할 수 있는 또 다른 옵션이 있습니다. ONNX 또는 오픈 신경망 교환은 ML 생태계 간에 학습 모델 파일을 변환할 수 있는 도구가 있는 오픈 소스 ML 소프트웨어 시스템입니다.

ONNX가 ML 생태계 간의 중간 단계 역할을 수행함으로써, 개발자는 다양한 ML 학습 방법으로 작업하고 다양한 방법에 걸쳐 모델을 최적화할 수 있습니다.

ML 소프트웨어 관련 주요 기사

Syntiant TinyML에 사용할 소프트웨어는?

Syntiant의 TinyML (Tiny Machine Learning, 초소형 머신 러닝) 개발 보드는 저전력 음성, AED(Acoustic Event Detection, 음향 사건 인지) 및 센서 머신 러닝 애플리케이션 구축을 위한 플랫폼입니다.

STM32 마이크로 컨트롤러에서 'Hello World' 머신 러닝 모델을 실행하는 방법

STM32 마이크로 컨트롤러에서 머신 러닝 응용 제품을 빠르게 시작하고 탐구하세요.

How to Perform Object Detection with TensorFlow Lite on Raspberry Pi

In this tutorial, I’ll walk you through the process of installing TensorFlow Lite on a Raspberry Pi and using it to perform object detection with a pre-trained Single Shot MultiBox Detector (SSD) model.

TensorFlow Lite for Microcontrollers Kit Quickstart

Machine learning has come to the 'edge' - small microcontrollers that can run a very miniature version of TensorFlow Lite to do ML computations. But you don't need super complex hardware to start developing your own TensorFlow models! We've curated a simple kit to dip your toes into machine learning waters.

에지 AI 및 ML 하드웨어

마이크로 컨트롤러용 TensorFlow Lite는 마이크로 컨트롤러급의 응용 프로그램을 위해 설계된 머신 러닝 소프트웨어 플랫폼입니다. 운영 체제, C/C++ 라이브러리와 동적 메모리 할당이 필요치 않아 마이크로 컨트롤러용 TensorFlow Lite는 표준 프로그래밍 옵션보다 작지만 훨씬 더 강력해집니다.

마이크로 컨트롤러에서 에지 AI를 사용하는 이유는 무엇인가요? 답변 보기

마이크로 컨트롤러는 전 세계 수십억 개의 장치에서 사용되는 작고 유연한 저전력, 저비용의 옵션입니다. 마이크로 컨트롤러는 전체 컴퓨터 시스템이 필요하지 않은 경우에 유리합니다. 로컬에서 결정을 내리고 수신 데이터를 처리할 수 있어서 마이크로 컨트롤러는 머신 러닝 분야에서 특히 주목받고 있습니다. 로컬에서 데이터를 처리하면 최종 사용자의 개인 정보를 보호할 수 있다는 추가적인 이점이 있습니다. 예를 들어, 현관 초인종의 비디오 데이터를 클라우드에 업로드하지 않고도 누군가 현관문으로 접근하고 있는지 확인하고 싶을 수 있습니다.

요구 사항

마이크로 컨트롤러용 TensorFlow Lite는 C++17 프로그래밍 언어로 개발되었으며, 실행을 위해서는 32비트 마이크로 컨트롤러 플랫폼이 필요합니다.

마이크로 컨트롤러용 TensorFlow Lite의 코어 런타임은 ARM Cortex M 플랫폼에서 최소 16KB의 메모리로 실행할 수 있으며, 대중적인 ESP32 플랫폼으로도 포팅되어 있습니다. 적당한 Arduino 플랫폼에서 작업하는 것을 선호한다면, 마이크로 컨트롤러용 TensorFlow Lite 프레임워크를 위한 Arduino 라이브러리도 있습니다.

마이크로 컨트롤러용 TensorFlow Lite의 제약 사항은 무엇인가요? 답변 보기

마이크로 컨트롤러용 TensorFlow Lite는 최소한의 하드웨어 요구 조건만 충족되어도 작동할 수 있는 강력한 머신 러닝 플랫폼이지만, 개발을 어렵게 만들 수 있는 몇 가지 제약 사항이 있습니다.

- 일반적으로 고성능 32비트 플랫폼의 소수의 소자만 공식 지원합니다.

- TensorFlow Lite와 마찬가지로, 마이크로 컨트롤러에서의 온디바이스 학습은 지원되지 않습니다.

- 기본 TensorFlow의 일부 하위 연산만 지원됩니다.

- 메모리 관리는 수동 설정으로 저수준 C++ 애플리케이션 프로그래밍 인터페이스(API)를 필요로 합니다.

기타 임베디드 시스템

임베디드 Linux를 실행할 수 있는 더 강력한 하드웨어 시스템 또는 Raspberry Pi 플랫폼과 같은 SBC에 ML 모델을 배포하는 경우, TensorFlow Lite 프레임워크가 통합하기에 더 쉬울 수 있습니다.

하드웨어 가속기

칩 수준에서, 머신 러닝과 신경망의 수학적 계산을 지원하기 위해 일부 프로세서에는 더 많은 전용 산술 논리 연산 장치가 추가되고 있습니다.

NPU

신경망 처리 장치(NPU)는 신경망에 기반하여 머신 러닝 및 인공 지능 응용 프로그램의 처리를 가속화하도록 설계된 특수 IC입니다.

신경망은 정보를 처리하고 전달하는 뉴런이라고 불리는 노드와 여러 계층이 상호 연결된 인간의 뇌를 기반으로 하는 구조입니다.

TPU

텐서 처리 장치(TPU)는 신경망 기반 시스템의 처리를 돕기 위해 2015년 Google에서 개발한 특수 IC로, NPU와는 달리 뉴런 기반 시스템 아키텍처로 처리하지 않고 행렬 곱셈과 합성곱 연산을 빠르게 처리하는 방식입니다.

TPU는 적은 에너지를 사용한 수학적 행렬 연산의 처리에 고도로 최적화되어 있어서 TensorFlow와 ExecuTorch처럼 수학적 행렬 연산을 사용하는 ML 모델의 학습에 이상적입니다.

1세대 TPU 하드웨어는 전력 공급 및 냉각 요구 사항 때문에 데이터 센터 응용 분야에서만 찾아볼 수 있었습니다. 하지만 최신 세대의 TPU는 에지 기반 응용 분야용으로 설계되고 있습니다.

에지 AI에서 CPU와 GPU를 더 많이 사용하지 않는 이유는 무엇인가요? 답변 보기

기존의 중앙 처리 장치(CPU)는 범용 연산에는 적합하지만 신경망의 모든 연산을 효율적으로 처리하는 데는 최적화되어 있지 않습니다. 그래픽 처리 장치(GPU)가 머신 러닝 및 인공 지능 응용 분야에서도 매우 유용해졌지만, 에너지 사용량과 필요한 하드웨어에 있어서의 높은 비용 때문에 에지에서의 사용이 제한됩니다.

입문 수준 제품

![]()

Raspberry Pi PicoBoard는 Raspberry Pi가 자체 개발한 RP2040 마이크로 컨트롤러 칩을 위한 저렴하면서도 유연한 개발 기판입니다.

중간 수준 제품

![]()

STMicroelectronics의 STM32N6은 800MHz로 실행되는 Arm® Cortex®-M55를 기반으로 합니다. Cortex-M55는 Arm Helium 기술을 도입한 최초의 CPU입니다.

![]()

Raspberry Pi 5는 64비트 쿼드 코어 2.4GHz Arm® Cortex®-A76 프로세서를 기반으로 구축되어 Pi 4에 비해 CPU 성능이 2~3배 향상됩니다.

고급 수준 제품

![]()

STM32MP25 2세대 애플리케이션 프로세서 - 출시 예정

STMicroelectronics의 2세대 STM32 마이크로프로세서는 연결된 산업 응용 분야에서 보안 컴퓨팅과 고급 엣지 AI를 구현합니다.

![]()

신경망 가속기가 내장된 초저전력 MAX78000 Arm® Cortex®-M4 프로세서

Analog Devices 의 MAX78000은 신경망이 초저전력으로 실행되고 IoT를 활용하도록 설계된 새로운 유형의 AI 마이크로 컨트롤러입니다.

![]()

ARM® Cortex™-M7 코어를 갖춘 32비트 STM32 F7 계열 MCU

STM32 F7 MCU 계열은 최대 200MHz의 주파수에서 작동하며 6단계 슈퍼스칼라 파이프라인 및 최대 1,000 CoreMarks를 생산하는 부동 소수점 처리 장치(FPU)를 사용합니다.

전문가 수준 제품

![]()

Seeed의 NVIDIA® Jetson Nano™ 개발자 키트는 최신 인공 지능 워크로드를 효율적으로 실행할 수 있는 성능을 소형 폼 팩터로 제공합니다.

![]()

Seeed의 NVIDIA® Jetson 원스톱 플랫폼은 인공 지능(AI), 엣지 컴퓨팅 및 다양한 산업용 임베디드 애플리케이션의 개발을 향상시킵니다.

추가 제품

에지 AI 하드웨어 관련 주요 기사

Practical Development Board Resources for Edge AI System Development

This video delves into the shift from “centralized intelligence” to “distributed intelligence,” introducing applications of TinyML and local offline AI.

Edge Impulse

Edge Impulse는 소프트웨어 개발자가 실제 데이터를 수집해 가져와 ML 모델의 구축, 학습 및 테스트를 에지 컴퓨팅 장치에서 효율적으로 실행할 수 있는 클라우드 기반의 통합 개발 환경(IDE)입니다.

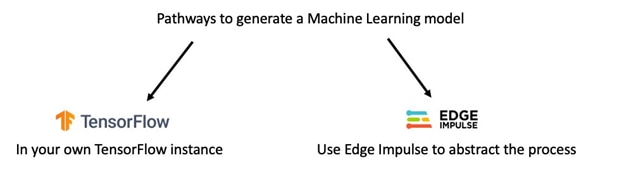

Edge Impulse와 TensorFlow 머신 러닝 소프트웨어의 차이점. Edge Impulse를 사용하면 모델 개발이 사용자로부터 추상화되는 반면 TensorFlow의 모델 개발 과정은 훨씬 더 복잡합니다.

Edge Impulse와 TensorFlow 머신 러닝 소프트웨어의 차이점. Edge Impulse를 사용하면 모델 개발이 사용자로부터 추상화되는 반면 TensorFlow의 모델 개발 과정은 훨씬 더 복잡합니다.

Edge Impulse의 장점

Edge Impulse 프레임워크는 오디오(마이크)에서부터 이미지(카메라), 센서 데이터(진동 센서)에 이르기까지 모든 데이터와 함께 사용할 수 있습니다. 몇 가지 추가적인 예는 다음과 같습니다.

- 물체 인식 및 이미지 감지(사람 감지 등)

- 오디오 감지를 통한 '호출 명령어'(스마트 홈 어시스턴트용)

- 이상 징후 감지(예측 유지보수용)

- 활동/패턴 인식(프로세스 간소화용)

Edge Impulse를 사용해야 하는 이유는 무엇인가요? 답변 보기

Edge Impulse는 ML 학습 소프트웨어(현재 대부분 TensorFlow)로 처리해야 하는 작업의 부담을 덜어줄 수 있습니다. Edge Impulse는 모델 학습을 위해 데이터를 태그하고 업로드할 수 있는 웹 기반 인터페이스를 제공합니다.

Edge Impulse는 ML 학습 소프트웨어를 처음 사용하거나 ML 개발자가 아닌 사용자를 위해 설계되었지만, TensorFlow python 프레임워크와 호환되므로 전문가 수준의 사용자도 충분히 활용할 수 있습니다. 에지 AI 모델 생성에 있어 코딩 문제를 상당 부분 해소하기 때문에, 코드를 실행하기 위해 어떤 python 라이브러리를 포함해야 하는지 보다 올바른 데이터 제공과 알맞은 모델 학습에 더 집중할 수 있습니다.

대부분의 개발자와 사용자를 위한 무료로 사용 가능한 버전이 있지만, 프로젝트의 수와 각 프로젝트가 사용할 수 있는 처리 능력에 한계가 있습니다. 전문 개발자를 위한 유료 버전이 있으며 Edge Impulse에 요금 협상을 문의할 수 있습니다.

Edge Impulse 관련 주요 기사

Espressif ESP32용 Edge Impulse 펌웨어

Edge Impulse는 에지 디바이스(edge device)에서의 머신 러닝을 개발하기 위한 선도적 개발 플랫폼 중 하나입니다.

Lego Brick Finder with OpenMV and Edge Impulse

In this tutorial, Shawn shows you how OpenMV and Edge Impulse trained for image recognition can be used to create Lego® brick finder.

Getting Started with the OpenMV Cam: Machine Vision with MicroPython

In this tutorial, Shawn shows you how to get started with the OpenMV H7 camera module, which uses MicroPython to perform a variety of machine vision tasks

Car Parking Detection System Using Edge Impulse

In this example project, we have built an object detection model to detect the number of cars in a parking lot and deploy it on a Raspberry Pi 4.

인기 있는 Edge Impulse 제품

![]()

Nordic Thingy:53 IoT 시제품 제작 플랫폼

![]()

Nordic Semiconductor의 Nordic Thingy:53은 통합된 동작, 소리, 빛 및 환경 센서를 활용하여 개념 증명 및 프로토타입을 구축하는 데 도움이 됩니다.

Edge Impulse와 호환되는 기판의 전체 목록: Edge Impulse Edge AI 하드웨어 개요

AI를 통한 감지

머신 러닝 모델을 실행하려면 임베디드 시스템이 필요하지만, AI에 기반한 전자 부품으로 출시되는 제품이 계속 늘어날 것입니다. 여기에는 머신 러닝 센서라고도 하는 AI 기반 센서도 포함됩니다.

머신 러닝 센서의 기능

대부분의 센서에서 머신 러닝 모델을 추가한다고 해서 응용 제품의 효율성이 더욱 향상되는 것은 아니지만, ML 학습을 통해 훨씬 더 효율적인 방식으로 작동할 수 있는 몇 가지 유형의 센서가 있습니다.

- 프레임 내 물체와 사람을 추적하는 머신 러닝 모델이 사용되는 카메라 센서

- 활동 프로필을 감지하는 IMU, 가속도계 및 동작 센서

머신 러닝이 탑재된 비전 센서

신경망을 사용하여 연산 알고리즘을 제공함으로써, 물체나 사람이 카메라 센서의 시야각에 들어오면 감지하고 추적할 수 있습니다.

인기 있는 AI 비전 센서 제품

![]()

DFRobot 센서는 오프라인 AI 제스처 및 얼굴 감지를 지원하여 클라우드를 사용하지 않고도 개인 정보를 보호하면서 3m 이내에서 5개의 손 제스처와 최대 10개의 얼굴을 인식합니다.

![]()

STM32 기판용 B-CAMS-OMV 카메라 모듈 번들

STMicroelectronics의 B-CAMS-OMV 카메라 모듈 번들은 확장 커넥터가 포함된 어댑터 기판이 있는 5Mpixel 카메라 모듈로 구성됩니다.

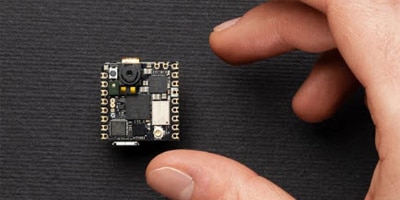

![]()

Arduino의 Nicla 기판은 원활하게 배포하도록 설계되어 사용자가 저전력 AI 및 기계 학습을 현재 설정에 쉽게 통합할 수 있습니다.

AI 비전 센서 관련 주요 기사

OpenMV 캠으로 머신 러닝을 물체 감지에 빠르게 적용

OpenMV H7 카메라 모듈을 활용하면 머신 러닝 알고리즘과 데이터 세트를 사용하여 물체를 감지하고 이미지를 처리할 수 있습니다.

Introducing the Arduino Nicla Vision Board for Professional Machine-Vision Applications

This article focuses on the main features and specifications of the Arduino Nicla Vision, a compact industrial-grade board that has the potential to drive professional machine-vision applications.

AI Vision Modules - Electronics with Becky Stern

AI vision boards allow you to incorporate features like face, person, and object recognition into your projects.

Getting Started with the OpenMV Cam: Machine Vision with MicroPython

In this tutorial, Shawn shows you how to get started with the OpenMV H7 camera module, which uses MicroPython to perform a variety of machine vision tasks.

머신 러닝이 탑재된 동작 센서

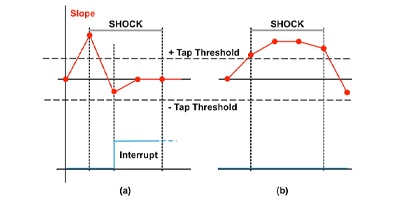

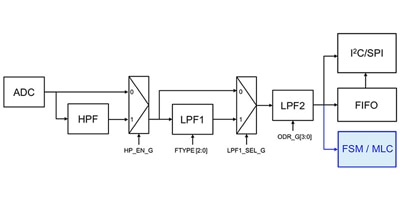

머신 러닝 플랫폼이 집적된 동작 센서는 동일한 패키지로 실시간 데이터 추적 및 처리가 가능하여 전력 소비와 처리 시간이 줄어듭니다. 이러한 유형의 센서에는 대부분 작은 연산 논리 기반 결정 트리가 있거나, 필터 또는 트리거 임계값을 미리 정의할 수 있는 기능이 있습니다. 입력 값이 이 값에 도달하면 기능을 수행합니다. 다른 동작 센서는 패키지에 DSP 유닛 전체가 집적되어 있어서 기본적인 CPU 없이도 전력과 시간을 절약하면서 여러 ML 알고리즘을 실행할 수 있습니다.

인기 있는 AI 동작 센서 제품

![]()

Bosch Sensortec의 BHI260AP 자가 학습 AI 스마트 센서는 소비자 가전 제품, 웨어러블, 히어러블 등과 같은 응용 제품에 적합합니다.

![]()

BHI385 스마트 IMU: 고가속 동작을 감지하는 내장형 AI

완벽하게 프로그래밍 가능한 Bosch Sensortec의 BHI385 관성 측정 장치는 확장된 g 가속도계, 통합 AI 및 초저전력 소비를 제공합니다.

동작 센서 관련 주요 기사

스마트 센서의 내장된 머신 러닝 코어를 사용하여 “상시 작동” 동작 추적 최적화

저전력 상시 작동 동작 추적을 위해 통합 머신 러닝 코어가 탑재된 스마트 센서를 사용하여 복잡한 이동 시퀀스를 감지합니다.

정말로 모든 미가공 센서 데이터가 필요하십니까? 아닙니다. 더 나은 방법이 있습니다!

스마트 센서를 사용하여 데이터 세트를 줄여 애플리케이션이 미가공 측정보다 관심 있는 이벤트에 더 집중할 수 있게 합니다.

ATtiny1627 Curiosity Nano를 사용하여 동작 감지 단순화

Microchip ATtiny1627 Curiosity Nano 및 PIR 센서를 통한 동작 감지에 대해 간단히 살펴보고 이를 활용하세요.

내구성이 뛰어나고 수명이 긴 고급 IMU를 사용하여 산업용 장치의 수명 보장

뛰어난 내구성이 보장되는 견고한 산업용 IMU는 산업용 장치의 강력한 성능, 안정성 및 수명에 대해 증가하는 요구 사항을 충족합니다.

Cat.Ai – Potentially Genius | DigiKey

n this episode, Tomorrow Lab collaborates Cornel Pizara from Analog Devices to create a product using the MAX78000— a new breed of AI Micro built to enable neural networks to execute at ultra-low power.

머신 러닝이 탑재된 환경 센서

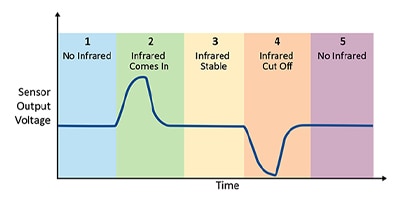

머신 러닝 플랫폼이 집적된 환경 센서는 실시간으로 환경 데이터를 처리하고, 머신 러닝 연산도 자체적으로 수행합니다. 이러한 유형의 센서 대부분은 급격한 온도 상승과 같은 환경 값의 이상 변화를 감지하며, 이는 냉각기가 꺼졌음을 나타낼 수 있습니다.

출처:

출처:  출처:

출처:

출처:

출처:  출처:

출처:  출처:

출처:  출처:

출처: